Wo sind all die Dienste hin? Worauf es bei Cloud-Ausfällen ankommt

Flexibel, skalierbar und kostengünstig: Die Dienste der Cloud-Giganten wie Amazon, Google oder Microsoft haben hunderttauende Kunden in Europa überzeugt. Aber was passiert, wenn deren Cloud-Infrastruktur ausfällt?

Anbieter zum Thema

Die Cloud ist in den meisten deutschen Firmen Alltag. So nutzen 75 Prozent der deutschen Unternehmen einen Provider, 67 Prozent haben bereits zwei und 42 Prozent sogar drei Cloud-Dienstleister unter Vertrag. Dies zeigt die Truth in Cloud Studie von Veritas. Die Dienstleister haben zurecht einen ausgezeichneten Ruf, was die Verfügbarkeit ihrer Dienste betrifft. In den vergangenen Jahren sind ihre Dienste nur sehr selten und dann nur kurz komplett ausgefallen. Trotzdem bleibt ein Restrisiko, das umso stärker ins Gewicht fällt, je wichtiger die Dienste der Unternehmen sind, die auf der Cloud laufen. Es ist deshalb wichtig, dass IT-Verantwortliche wissen und verstehen, wo Gefahren lauern und wo die Verantwortlichkeiten liegen.

Die Provider selbst handeln nach einem Shared Responsibility Modell, bei dem immer ein Teil der Verantwortung beim Kunden liegt. So bleibt der Kunde immer für seine Daten und deren Compliance verantwortlich. Werden Daten korrumpiert oder gehen verloren, liegt die Verantwortung aufseiten der Kunden, diese aus einem eigenen Backup zu rekonstruieren.

Das ist auf Firmenseite noch zu wenig in den Köpfen mancher IT-Leiter verankert, denn weitere Ergebnisse der Veritas Studie zeigen: 83 Prozent der deutschen Firmen, die IaaS nutzen oder dies planen, sehen die Verantwortung für Datensicherung in der Cloud bei den Cloud Service Providern. Und 69 Prozent sind fest überzeugt, dass sie die Verantwortung für Datensicherheit, Datenschutz und Compliance an ihre Cloud Service Provider delegieren können. Wer mit den Daten seinen Teil der Verantwortung in die Cloud schiebt, ist für den Ernstfall schlecht oder gar nicht vorbereitet.

Auch in Fragen der Hochverfügbarkeit ist manchem IT-Leiter nicht klar, was die Cloud Provider abdecken und was ein Unternehmen selbst tun muss. So geben die Public-Cloud-Dienstleister klare und strenge Garantien für ihre Service Level ab, diese beziehen sich aber meistens nur auf die Verfügbarkeit der Infrastruktur in der Cloud. Fällt sie aus, müssen die Provider sie wieder zum Laufen bringen. Doch danach liegt es an Kunden, die darauf laufenden Dienste und Anwendungen selbst wieder in Betrieb zu nehmen. Je komplexer die Anwendungen strukturiert sind und je mehr Daten während des Ausfalls verloren gehen, desto länger wird die Wiederherstellung der kritischen Applikationen dauern. Oft nutzen die IT-Abteilungen für diese Aufgabe isolierte Tools und manuelle Prozesse, ohne Automatismen. Da geht im Ernstfall wertvolle Zeit verloren, die sich dann in teurer Downtime der wichtigen Dienste manifestiert.

Testen im laufenden Betrieb

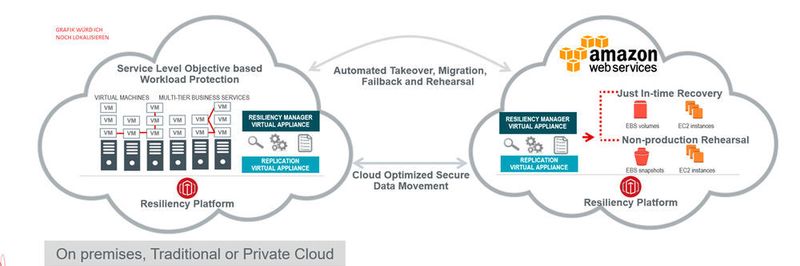

Die Wiederherstellung der Daten und Dienste nach einem Cloud-Ausfall ist dann schwer beherrschbar und wird unkalkulierbar. IT-Leiter können ein klares Zeichen setzen, wenn sie diese wichtigen Prozesse professionalisieren. Für diesen Zweck gibt es Lösungsansätze wie die Business-Continuity-Plattofrm „Resiliency Platform“ von Veritas. Sie helfen dabei, mehrstufige Applikationsarchitekturen und ihre Verfügbarkeit rund um die Uhr zu kontrollieren, den Ausfallprozess zu testen und den Failover-Prozess im Ernstfall mit einem Mausklick automatisch und kontrolliert abzuwickeln.

Solche Konzepte müssen sich eng an die Infrastruktur der führenden Cloud-Anbieter ankoppeln, um nahtlos von einer Cloud-Infrastruktur auf eine andere oder auf ein lokales Rechenzentrum des Kunden umschalten zu können. Dafür nutzen sie deren Protokolle, Dienste und Data Mover und sind von den wichtigen Cloud Providern entsprechend zertifiziert. Sie sind daher auch in der Lage, die Struktur der Applikationen sowohl on premises als auch in der Cloud automatisch und mit geringer Fehlerquote per Autodiscovery zu erfassen, zu verstehen und die zu sichernden Applikations-Elemente so zu identifizieren. Die IT-Abteilung wird entlastet und es ist weniger wahrscheinlich, dass ein essenzieller Teil einer mehrstufigen Applikation übersehen wird.

Die Ergebnisse der Autodiscovery laufen in einer zentralen grafischen Oberfläche und einem Dashbard zusammen. Dort kann der IT-Verantwortliche, die Ergebnisse des gesamten Disaster-Recovery-Prozesses überblicken und per Drag & Drop modellieren. Im nächsten Schritt kann er einen großen Vorteil einer solchen übergreifenden Instanz ausspielen – das Testen des gesamten Vorgangs, ohne den Betrieb zu stören.

Per Mausklick lassen sich belastbare Werte in der Praxis ermitteln, wie lange der gesamte Umschaltprozess dauert, wie viele Produktiv-Daten verloren gehen. Der Ernstfall wird auf einmal berechenbar und kalkulierbar. Den zweiten großen Vorteil spielen solche Business-Continuity-Plattformen dann im Ernstfall aus – ihren Automatismus, der in der Krisensituation den komplexen Failover-Prozess automatisch abwickelt, und zwar nach den vorher im Test gemessenen Kriterien für die Dauer und die Menge der Daten, die während der Umschaltzeit verloren gehen könnten. IT-Leiter wissen nun, wie lange es dauert, wichtige Geschäftsanwendungen wiederherzustellen. Denn sie können mit Werten, die unter realen Bedingungen ermittelt wurden, den Ernstfall beschreiben.

Wissen was zu tun ist

Es ist gut , wenn IT-Leiter die Folgen eines Cloud-Ausfalls genau verstehen und sich darüber im Klaren sind, dass die Wiederherstellung nach dem Ausfall nur gemeinsam mit dem Cloud Service Provider zu stemmen ist. Richten Unternehmen für ihre Anwendungen bereits im Vorfeld entsprechende Ausfallmechanismen für die Multi-Cloud ein, haben sie im Ernstfall nicht nur die volle Verantwortung, sondern auch die volle Kontrolle über die Wiederherstellung ihrer kritischen Services. So reduziert der IT-Leiter Ausfallzeiten, einen Vertrauensverlust auf Kundenseite und damit finanzielle Schäden.

Der Autor: Mathias Wenig, Senior Manager TS und Digital Transformation Specialist bei Veritas.

(ID:45494931)

:quality(80)/p7i.vogel.de/wcms/c5/45/c54568adfee2a4c6ed992a94abebdb5e/0126992413v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/13/3f/133f5ccfbd6ce74a4f52ca35ea85669f/0127552212v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/43/e4/43e42f37cc71f12e6ae46717e700644e/0126701619v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/3b/b8/3bb80b6a0c2e58c6adbe7b40df86aa12/0130692502v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/e8/38/e8387251b85fc72e0f56d2fa1915043d/0129328744v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/95/d6/95d6c599b3ff7ee542b413a6bf68af69/0129076535v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/02/c4/02c469dd5e11473510bdfdd6dde99719/0131275751v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/2e/31/2e31ed31b8faaeaa7e579a7952d66a2a/0131253749v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/97/29/9729f17d4d66f867ba148e9846b65748/0131002148v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/dd/42/dd42b581276b63123200a2faf3333492/0131003047v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/22/54/2254f05b0c481c9db7dd3a7ef6614ce5/0130957487v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/28/53/28535033219468d81b9b0b5d884150ac/0131042905v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/04/3b/043b590037354e37ee37717c92722d49/0131021993v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/df/70/df70bfea1ddab39aa5a22ba5abea9bc0/0131332389v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/0d/ec/0decf28b28ce464118e73660b989227f/0131407472v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/06/51/065118df1c315ab041a7720f44d1e5c8/0130704423v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/df/2a/df2a8e9b94e67d9df9f18cba1a17915c/0131349649v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/d4/5c/d45c4cf3f65bc8505a93d71fd03c4ce2/0131336779v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/1f/17/1f17658cb9928421650a1a3bce724c09/0131253336v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/2e/04/2e041e93b1d72f6580291bb5f234b5c5/0130963060v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/81/bf/81bf238709bbe95944c3060987a03a87/0130887672v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/b6/f7/b6f78db91e856c49b8cdb62d1ac26bdc/0130861223v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/9e/fb/9efb713bc5316df064c44a7681ed32f3/0129327209v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/85/43/8543c4ba7474a14bd966f159a0182837/0131444009v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/e3/7a/e37a853307b036842e48949f5a0f3826/0130736761v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/7d/12/7d1283193b77fa14584f7ecf758d0c44/0131036636v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/55/40/55408a295562add72c6053f7e9793019/0130765706v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/d0/a7/d0a75a38f1d89e22d498cdd6fb6339f1/0130911335v1.jpeg)

:fill(fff,0)/p7i.vogel.de/companies/65/a4/65a4b6173962d/cloudgrmany-logo.png)

:fill(fff,0)/p7i.vogel.de/companies/69/8c/698c4ebef13d1/stackit-logo-horizontal-primary-pos-navy-rgb.png)

:fill(fff,0)/p7i.vogel.de/companies/69/6f/696f5d0545dbe/yorizon-logo-schwarz.png)

:quality(80)/images.vogel.de/vogelonline/bdb/1454100/1454113/original.jpg)

:quality(80)/images.vogel.de/vogelonline/bdb/1454100/1454114/original.jpg)

:quality(80)/images.vogel.de/vogelonline/bdb/1454100/1454115/original.jpg)

:quality(80)/p7i.vogel.de/wcms/10/7e/107e2a602907f5f8c0706628e52c3a9c/0125332406v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/47/c3/47c38f4359d38b21aa65391358de5fca/0128106074v1.jpeg)