Multi-Cloud-Analyse und Confidential Computing Google Cloud Next OnAir mit Fokus auf Hybrid- und Multi-Cloud-Datenmanagement

Google Clouds jährliche, weltweite Kunden- und Partnerkonferenz fand in diesem Jahr ebenfalls pandemiebedingt – „on air“ – rein digital statt. Zum Start der virtuellen „Next 2020“ kündigte der Konzern neue Lösungen für intelligente Datenanalyse und sicheres Computing an.

Anbieter zum Thema

Seit 20 Jahren habe es sich Google zur Aufgabe gemacht, Unternehmen bei der Bewältigung ihrer Datenprobleme zu unterstützen, sagte Kirsten Kliphouse, President North America Google Cloud, bereits im Vorfeld der digitalen Veranstaltungsreihe. Die Mission Google Clouds, „transform through data“, solle Organisationen auf ihrem Weg der digitalen Transformation zu begleiten.

Multi-Cloud-Nutzung ist Standard

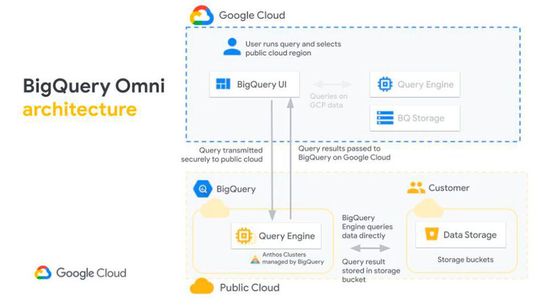

Google Cloud gehe es insbesondere darum, Daten, die häufig separat lokal, auf proprietären Systemen oder in verschiedenen Clouds gespeichert sind, uneingeschränkt nutzbar zu machen. Daher liege der Produktschwerpunkt immer mehr auch auf Lösungen, die helfen, diese Silos aufzubrechen und Daten cloud-übergreifend verfügbar zu machen. Das Verschieben von Daten über verschiedene Clouds sei umständlich und auch teuer, da in der Regel Gebühren für die Übertragung von Daten von anderen Cloud-Anbietern in die Google Cloud anfielen, erklärte Debanjan Saha, General Manager und Vice President of Engineering, Google Cloud, bei Vorstellung der neuen Multi-Cloud-Analyselösung BigQuery Omni.

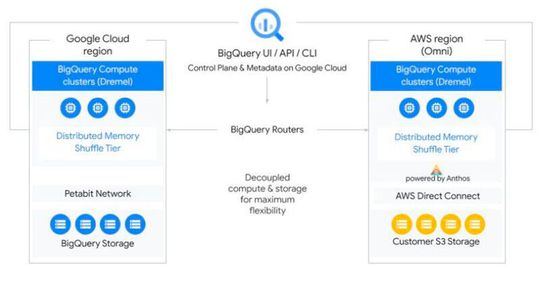

BigQuery Omni soll die Datenanalyse über verschiedene Cloud-Plattformen hinweg ermöglichen. Das neue Produkt basiert auf der Anwendungsplattform Anthos, mit der Anwender ihre Daten direkt über Google Cloud, Amazon Web Services (AWS) und in Kürze auch Microsoft Azure zu Analysezwecken verbinden können, ohne Datensätze verschieben oder kopieren zu müssen. Über eine einzige Benutzeroberfläche können Kunden die Daten dort analysieren, wo sie abgelegt sind.

BigQuery Omni ist ab sofort in der Version Private Alpha für AWS S3 verfügbar, die Unterstützung für Azure soll bald folgen. BigQuery Omni unterstützt Avro, CSV, JSON, ORC und Parkett.

Neues Confidential-Computing-Portfolio

Ein weiteres großes Thema der „Next 2020“: Die Verschlüsselung von Daten. Hier kündigte Google Cloud zwei neue Sicherheitsangebote an. Unternehmen, aber auch Behörden, die ihre Workloads in die Cloud verlagern, stehen schließlich vor dem Problem, diese Daten vertraulich und privat halten zu müssen. Google Cloud verschlüsselt zwar die Daten während der Speicherung und Übertragung, allerdings müssen diese Kundendaten für die Verarbeitung wieder entschlüsselt werden.

Daher führt Google Cloud das neue Portfolio für Confidential Computing ein. Diese neue Technologie erlaubt es, Daten während der Verarbeitung zu verschlüsseln. In Confidential-Computing-Umgebungen sollen Daten in-memory und auch außerhalb der Zentraleinheit (CPU) verschlüsselt werden. Damit sei Google Cloud der erste große Cloud-Anbieter, der ein solches Maß an Sicherheit und Isolierung in einer Lösung biete, die weder eine Änderung des Codes in Apps noch Einbußen bei der Rechenleistung verlange.

Das erste Produkt, das Google Cloud hier auf den Markt bringt, ist Confidential VMs. Google Cloud verwendet zwar bereits verschiedene Isolations- und Sandboxing-Verfahren als Teil seiner Cloud-Infrastruktur, um die multi-mandantenfähige Architektur zu sichern. Confidential VMs – aktuell in der Beta-Phase – gehen noch einen Schritt weiter und bieten eine Arbeitsspeicher-Verschlüsselung. So können Kunden virtuelle Maschinen in der Cloud weitgehend isolieren. Confidential VMs sind auf AMD CPUs verfügbar und nutzen die Vorteile der sicheren verschlüsselten Virtualisierungstechnologie, die von AMD EPYC-CPUs der zweiten Generation unterstützt wird.

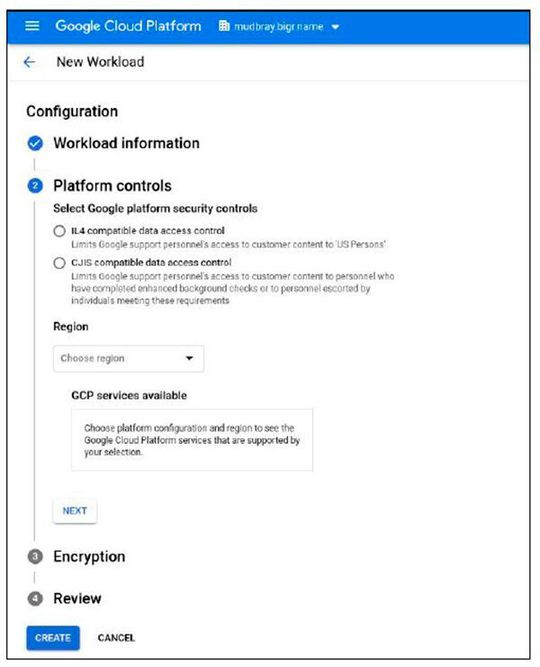

Doch auch für Regierungsbehörden, die ihre IT mit Cloud-Technologien modernisieren möchten, ist die Gewährleistung der Sicherheit, des Datenschutzes und der Einhaltung gesetzlicher Vorschriften für ihre Arbeitslasten unerlässlich. Für die vertrauliche Datenverarbeitung in Behörden, kündigte Google Cloud „Assured Workloads for Government“ an, was allerdings zuerst auf dem US-amerikanischen Markt verfügbar sein wird. Viele Cloud-Anbieter hätten bisher separate Umgebungen („Regierungs-Clouds“) aufgebaut, um die strengen Compliance-Anforderungen für die Verarbeitung von bundes-, landes- und kommunalbehördlichen Daten zu erfüllen. Mit dem Manko allerdings, dass diese auf weniger funktionsreichen, abgesicherten Versionen kommerzieller Clouds laufen müssen.

Google Cloud hält die neue Lösung „Assured Workloads for Government“ für den besseren Weg, einfach und schnell kontrollierte Umgebungen zu erstellen, in denen Datenstandorts- und Personenzugriffskontrollen automatisch durchgesetzt werden können. Die globale Auslieferung der Lösung ist geplant.

Vollgas bei Industrie 4.0

Neben den neuen Produkten kündigte Google Cloud zu Beginn seiner digitalen Veranstaltungsreihe auch weitere Partnerschaften an. Aus europäischer Sicht besonders interessant ist die bereits im Vorfeld verkündete Zusammenarbeit mit der Deutschen Bank. Ein ähnliches Kaliber hat die neue Industrie- und Technologiepartnerschaft mit der französischen Groupe Renault, um die industriellen Systeme in Richtung Industrie 4.0 zu transformieren. Neben der Digitalisierung der Produktionsanlagen sollen neue Branchenlösungen entwickelt werden.

Groupe Renault hat 2006 mit der Entwicklung einer eigenen digitalen Plattform begonnen, um die Industriedaten aus weltweit 22 Konzernstandorten und über 2.500 Maschinen zu verbinden und für den Erkenntnisgewinn zu sammeln. Die neue Partnerschaft mit Google Cloud hat vor allem das Ziel, die unabhängig betriebene industrielle Datenmanagementplattform von Groupe Renault zu optimieren. Der Automobilkonzern will zudem mit den Lösungen und der Expertise von Google Cloud in den Bereichen intelligente Analytik, maschinelles Lernen (ML) und künstliche Intelligenz (AI) seine Lieferketten und die Fertigung effizienter machen, die Produktionsqualität erhöhen sowie durch Energieeinsparungen die Umweltbelastung verringern.

Es geht noch weiter

Über die kommenden neun Wochen finden im Rahmen der Google Cloud Next 2020 OnAir über 200 kostenlose Sessions statt, die neben den Keynotes vieler Branchenkoryphäen vor allem zahlreiche Weiterbildungsmöglichkeiten mit führenden Google-Entwicklern bieten.

:quality(80)/images.vogel.de/vogelonline/bdb/1549600/1549678/original.jpg)

OK Google, what´s Next?

Google Cloud auf Aufholjagd

:quality(80)/images.vogel.de/vogelonline/bdb/1649200/1649253/original.jpg)

Google Cloud Next `19 UK

„Die Cloud ist Grundvoraussetzung für mehr Umsatz“

(ID:46714462)

:quality(80)/p7i.vogel.de/wcms/c5/45/c54568adfee2a4c6ed992a94abebdb5e/0126992413v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/13/3f/133f5ccfbd6ce74a4f52ca35ea85669f/0127552212v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/43/e4/43e42f37cc71f12e6ae46717e700644e/0126701619v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/3b/b8/3bb80b6a0c2e58c6adbe7b40df86aa12/0130692502v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/e8/38/e8387251b85fc72e0f56d2fa1915043d/0129328744v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/95/d6/95d6c599b3ff7ee542b413a6bf68af69/0129076535v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/02/c4/02c469dd5e11473510bdfdd6dde99719/0131275751v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/2e/31/2e31ed31b8faaeaa7e579a7952d66a2a/0131253749v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/97/29/9729f17d4d66f867ba148e9846b65748/0131002148v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/dd/42/dd42b581276b63123200a2faf3333492/0131003047v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/22/54/2254f05b0c481c9db7dd3a7ef6614ce5/0130957487v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/28/53/28535033219468d81b9b0b5d884150ac/0131042905v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/04/3b/043b590037354e37ee37717c92722d49/0131021993v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/df/70/df70bfea1ddab39aa5a22ba5abea9bc0/0131332389v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/0d/ec/0decf28b28ce464118e73660b989227f/0131407472v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/06/51/065118df1c315ab041a7720f44d1e5c8/0130704423v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/df/2a/df2a8e9b94e67d9df9f18cba1a17915c/0131349649v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/d4/5c/d45c4cf3f65bc8505a93d71fd03c4ce2/0131336779v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/1f/17/1f17658cb9928421650a1a3bce724c09/0131253336v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/2e/04/2e041e93b1d72f6580291bb5f234b5c5/0130963060v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/81/bf/81bf238709bbe95944c3060987a03a87/0130887672v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/b6/f7/b6f78db91e856c49b8cdb62d1ac26bdc/0130861223v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/9e/fb/9efb713bc5316df064c44a7681ed32f3/0129327209v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/f0/23/f0234e399bf3f55121ffb11838789eff/0131476390v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/85/43/8543c4ba7474a14bd966f159a0182837/0131444009v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/e3/7a/e37a853307b036842e48949f5a0f3826/0130736761v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/7d/12/7d1283193b77fa14584f7ecf758d0c44/0131036636v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/55/40/55408a295562add72c6053f7e9793019/0130765706v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/d0/a7/d0a75a38f1d89e22d498cdd6fb6339f1/0130911335v1.jpeg)

:fill(fff,0)/images.vogel.de/vogelonline/companyimg/135400/135488/65.jpg)

:fill(fff,0)/p7i.vogel.de/companies/68/6c/686cc778b54e4/flexera-no-tagline-rgb-full-color.png)

:fill(fff,0)/p7i.vogel.de/companies/65/a4/65a4b6173962d/cloudgrmany-logo.png)

:quality(80)/p7i.vogel.de/wcms/bb/d3/bbd3d36f04af7fab54a986c58d40615e/0129551486v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/6c/4d/6c4dc6301330248ca4a345613d256d20/0125831551v1.jpeg)