Industrie 4.0 von IBM & Boston Dynamics Roboterhund lernt KI, Cloud und 5G bei der IBM

Der Roboterhund SPOT von Boston Dynamics hat einen athletischen, gestählten Körper. Jetzt lernt er bei der IBM als PLUTO auch noch Künstliche Intelligenz, Cloud, Edge und 5G dazu. Wir haben den harten Hund im IBM Watson Center Munich besucht. Dr. Martin Junghans von IBM hat ein paar Dressur-Nummern vorgeführt. Und die besten Einsatzgebiete erklärt.

Anbieter zum Thema

Dr. Junghans, wie schlau ist Ihr RoboDog?

Dr. Martin Junghans: Der Roboter ist eine mobile Sensor-Plattform, in der wir Künstliche Intelligenz (KI), Cloud und Edge Computing, sowie 5G zusammenbringen. Diese Kombination ermöglicht uns beispielsweise, Arbeiter durch autonome Inspektionen von Industrieanlagen zu unterstützen, und die Arbeitsabläufe intelligenter zu realisieren. Bevor wir jedoch über Edge und Cloud Use Cases reden, müssen wir seine Hardware verstehen: Den Hersteller des Roboters, Boston Dynamics, gibt es seit 30 Jahren als Firma. Die beschäftigen sich mit sogenannter athletischer Intelligenz, also der Frage: Wie kann ich einem Roboter das Laufen anhand von Menschen oder Tieren als Vorbildern beibringen? Auch wenn er mal stolpert, und das kann er auch, reagiert er in Millisekunden, und kann sein Gewicht wieder austarieren. Er kann über steiles, unwegsames Gelände gehen, das für Menschen deutlich schwieriger wäre.

Hat er auch einen Namen?

Der gelbe Körper ist der Roboter Spot von Boston Dynamics. Er ist vor ca. zwei Jahren auf den Markt gekommen. Wir nennen ihn in unserem Watson Center auch PLUTO. Diese Roboter sind sehr robust für einen industriellen Einsatz gebaut.

In welchen Branchen sehen Sie, als IBM, diesen RoboDog?

Vor allem in der Industrie-Produktion, in der Logistik, Lagerhallen, in der Energiewirtschaft bis hin zu öffentlichen Gebäuden und Sicherheit. In Zeiten der Energiewende steigt die Notwendigkeit für den fehlerfreien Betrieb von Umspannwerken und Verteilstationen der Stromnetze. Grundsätzlich eignet sich Spot in allen gefährlichen Umgebungen. Auch in Atomreaktoren: Er hält ja eine gewisse Strahlung aus. Für uns ist es ein Dynamic Sensing Device: Für Umgebungen, in denen es jeden Tag anders aussieht. In Lagerhallen etwa: Da stehen die Kisten jeden Tag an einem anderen Platz.

Wie funktionert das dann beispielsweise?

Wir bringen die Sensorik mit dem Hund zu den Anlagen, zu den Objekten, die es zu inspizieren gilt. Etwa in den sogenannten Asset-intensive Industries. Dieser Sektor hat teure Produktionsanlagen, die oft über 25 Jahre hinweg laufen. Diese mit neuer Konnektivität auszustatten, kann schnell aufwändig und unrentabel sein. Manchmal ist es sinnvoller, wenn der Hund die eigene Sensorik von Zeit zu Zeit an den Ort des Bedarfs vorbeibringt, anstatt sie dort überall fest zu verbauen. Ähnlich wie Anlagenführer und Instandhalter heute ihre Runden drehen. Wir sammeln dann Daten über den Zustand und die Leistungsfähigkeit. Und wollen mittels KI Vorschläge rechtzeitig machen, beispielsweise bevor Fehler auftreten, die Instandhaltungsaufträge erzeugen.

Sozusagen KI direkt auf dem Buckel?

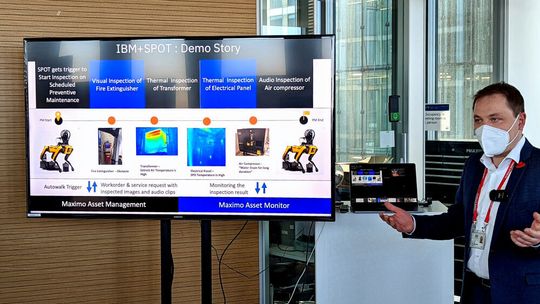

Genau, wir bringen die Künstliche Intelligenz direkt auf den Roboter. Dazu arbeiten wir als Partner mit Boston Dynamics stark zusammen, in gemeinsamen Kundensituationen. Die KI-Modelle sowie die Logik zur lokalen Datenverarbeitung kommen containerisiert von der Cloud in den Edge Computer. In der Cloud oder einem Edge Server, zum Beispiel in einem Werk, werden die containerisierten Anwendunden und KI-Modelle verwaltet und re-trainiert. Hier können auch je nach Use Case Anwendungen wie unsere Maximo Application Suite für das Enterprise Asset Management, Predictive Maintenance, Visuelle Inspektion und vieles mehr laufen.

An welchen Use Cases arbeitet IBM?

Wir haben viele laufende Projekte aus verschiedenen Industrien. Technologisch sind die Anwendungsfälle sehr ähnlich: Wir sammeln sensorische Daten und verarbeiten diese, bevor die Erkenntnisse zu Aktionen meist in einem Backend-System führen. IBM bringt die Erfahrung und Werkzeuge mit, um den Lebenszyklus der Software in verteilten Systemen Herr zu werden.

Greifen wir mal zwei konkrete Beispiele heraus, die wir ebenfalls gerade für das Watson Center implementieren: Feuerlöscher überprüfen! Da kann der PLUTO checken: Hängen oder stehen alle Feuerlöscher noch an der geplanten Station? Sind einige schon beschädigt? Sind noch alle Plomben dran? Wenn die Bildauswertung erkennt: Da fehlt ein Teil, oder der Feuerlöscher ist mit Gerümpel zugestellt, wird ein Auftrag erstellt, dass ein Mensch zielgerichtet den Sachverhalt überprüft.

Oder Trafos prüfen! Die Überwachung der Temperaturen bei mechanischen und elektrischen Komponenten wie Klimaanlagen, Schaltschränke oder Umspannwerke ist ausschlaggebend. Überhitzt hier etwas? Kommt irgendwo zu warme Abluft aus einem Gebilde? Dafür haben wir schon einige Use Cases programmiert, wie der Roboter solche Missionen autonom durchführen kann. So kann man das manuelle Durchschreiten großer Gebäude durch Inspektions-Läufe im Rahmen präventiver Wartung zur Kostenreduktion mittels RoboDogs automatisieren.

Das hört sich an, als sei der RoboDog in für Menschen potenziell gefährlichen Situationen einsetzbar?

Auf jeden Fall. Bei National Grid kommen Spot und IBM für verschiedene Szenarien zum Einsatz. Darunter werden in Umspannwerken frei liegende Isolatoren an den Hochvolt-Stromleitungen durch mechanische Belastung über die Zeit beschädigt und isolieren sie nicht mehr richtig. Dann überhitzen sie schnell. Früher musste man den Starkstrom abschalten und eine Person zur Untersuchung hinschicken. Das war aufwändig, gefährlich und kostenintensiv. Jetzt läuft der RoboDog mit der Thermalkamera durch die Anlage und misst kontinuierlich die Temperaturen an den kritischen Stellen.

Wie sieht das Einsatzszenario in der Produktion aus?

Der RoboDog kann mit einem zusätzlichen Lidar-Scanner ein genaues Abbild der Umgebung, etwa einer Produktionsstätte, erstellen: Wo habe ich noch Platz? Wo kann ich neue Teile reinstellen? Gerade ein Autohersteller, der alle sieben Jahre die Modelle und damit die Fertigungsprozesse aktualisiert, muss wissen, wie es wirklich aktuell in den Hallen aussieht, bevor er sein neues Fabriklayout planen kann. Außerdem sind diese genauen 3D-Modelle häufig die visuelle Grundlage für den Aufbau eines Digitalen Zwillings in Kombination mit Live-Daten, um einen intuitiven Überblick über Zustand und Produktivität meiner Anlagen zu bekommen. Oder auch den Techniker zu unterstützen, schnell an den Einsatzort zu gelangen, um Fehler zu beheben.

Auf diese Weise lassen sich sicherlich auch große Gebäude penibel vermessen, oder?

Natürlich kann man das gleiche auch bei Gebäuden machen: Für die Erstellung von Building Information Models läuft der RoboDog in alle Räume und vermisst die Räume und kann auch Gegenstände und Ausstattungen inventarisieren. So kann man die Ist-Aufnahme von Gebäuden weitgehend automatisieren.

Mit dem Watson Center haben Sie hier ja auch ein großes Gebäude?

Ja klar, unser Hund hat mit seinen seitlichen Stereo-Kameras, die eine geringere Reichweite von bis zu vier Metern haben, die Möglichkeit, ein 3D-Modell als Punkte-Wolke zu erstellen. Damit ist er auch schon unser 22stes Stockwerk hier im Watson Center München abgelaufen. Weiß markiert ist die abgelaufene Route. Am Rand sieht man Wände und andere Objekte. Die grauen Sitzbänke in den Lab-Bereichen hat er auch gleich aufgenommen, um so ein 3D-Modell zu erstellen. Der Hund baut schon während der Messungen einen Gebäudeplan auf. Obwohl er immer nur vier Meter weit schaut, kann er sich trotzdem in seinem eigenen Plan mit jeder Minute besser im Gebäude orientieren. Mit Hilfe von Wegpunkten kann ich dann autonome Missionen programmieren. Dabei können unbekannte Hindernisse auch problemlos den direkten Weg versperren. Dank des Models werden alternative Pfade genutzt.

Wie ist denn Ihr Pluto auf Hardwareseite technisch ausgestattet?

Es ist ein Roboter, mit vier Beinen, fünf Stereo-Kameras, vorne zwei, links und rechts außen jeweils eine, plus hinten eine. Mit diesen Stereo-Kameras, optisch und mit Laser, kann er im Raum navigieren und erkennt Objekte und vermeidet Kollisionen mit Hindernissen. Wenn ich ihn auf eine Person zu laufen lasse, dann hält er Abstand. Wir können selbst einstellen, wie viel Sicherheitsabstand er halten soll.

Und Augen hat er auch.

Wir haben zusätzliche, hochauflösende Kameras im vorderen Bereich als sogenannte Payload von Boston Dynamics, angebaut. Eine 30-fach hochauflösende Kamera vorne: Die können wir auch drehen und stark zoomen. So kann man etwa in einer großen Halle das hinterste Objekt kontrollieren: Ob etwa der Rauchmelder noch blinkt. Ohne dass da jemand hinlaufen muss, nicht einmal der kleine Roboter selbst, der hat halt gute Augen. Zusätzlich haben wir eine Infrarot-Kamera, um Temperaturen zu messen. Alles was Wärme und Kälte erzeugt, ist damit überwachbar. Zum Beispiel bei der Überwachung von Kühlanlagen oder Schaltschränken oder auch im zivilen Anwendungsfall bei einem Brand in einem Häuserkomplex. Da kann der RoboDog eine erste Bestandsaufnahme machen oder Brandnester identifizieren. Zudem haben wir auch eine 360-Grad-Kamera, um Rundum-Bilder zu erstellen. Eine Rundum-Beleuchtung mit LEDs erleichtert das Sehen in dunklen Umgebungen.

Hat er auch „Ohren“ und „Stimme“?

Im erwähnten Anwendungsfall kann man auch über das verbaute Mikrofon und Lautsprecher des RoboDogs Verletzte oder Verschüttete ansprechen. In industriellen Anwendungsfällen werten wir häufig Geräusche von Anlagen aus, um Fehler und Abnutzungsverhalten erkennen zu können. Außerdem können Sprachbefehle für die Zusammenarbeit von Menschen und Roboter ein präferierter und effektiver Modus für die Interaktion sein. Hierzu werden wir mit Watson Assistent erste Interaktionen mit Pluto demnächst testen.

Gerade im Katastrophenfall kommt es auf jede Sekunde an. Welche Technik kommt zum Einsatz, um schnelle Antwortzeiten und geringe Datenlast zu gewährleisten?

Dr. Martin Junghans: Alle Kamera-Bilder laufen erst mal auf dem Edge-Computer. Das ist ein vollwertiger Rechner mit einer leistungsstarken CPU, aber auch Grafikkarte, alias GPU. Der PC nutzt neuronale Netze und KI zur Auswertung der Bilddaten, der Videodaten, der Audiodaten, und sonstiger Sensordaten. Das machen wir gleich vor Ort, direkt auf dem Hunde-Buckel, damit wir die hochauflösenden Bilder oder Videostreams erst gar nicht komplett in die Cloud oder auf Server in der Nähe hochladen müssen. Hier ist es häufig effizienter die Datenmenge unmittelbar zu reduzieren und kann die Laufzeit der Batterien schonen. Wir prüfen also gleich im Edge-Computer auf dem Hund: Was lässt sich schon vor Ort berechnen? Welche Daten kann man gleich am Edge wieder wegwerfen? Nur der wertvolle Rest der Daten wird dann über das Netzwerk in die Cloud hochgeschickt, etwa per WLAN, oder mittels 5G.

Wie lange hält der Akku des RoboDog?

Dr. Martin Junghans: Der Akku hängt unten am Bauch. Er ist auf 90 Minuten ausgelegt, das hängt auch vom Gelände ab. Starke Verbraucher sind vor allem die große Kamera vorne, und der leistungsstarke Edge-Computer dahinter.

Ist es sehr kompliziert, „SPOT“ zu steuern und zu bedienen?

Dr. Martin Junghans: Hier haben wir den Controller, der auch die Bilddaten der Kameras anzeigen kann. Für den Bediener ist es hilfreich, dass er die Lage aus dem Blickwinkel des RoboDogs beurteilen kann. Über die Joysticks kann ich den Roboter steuern, ähnlich wie an einer Playstation. Sehr intuitiv, sehr einfach.

Versteht er auch WLAN?

Dr. Martin Junghans: Ja, hier im IBM Office arbeiten wir über unser ganz normales WiFi. Da ist die WLAN-Reichweite bekanntlich durch Wände und Decken limitiert, aber solange Roboter und Controller sich im selben Netz befinden, können diese auch weit voneinander entfernt sein. Der RoboDog kann aber auch seinen eigenen WLAN-Hotspot aufspannen. Dann ist er funktechnisch komplett autark. Und der Controller muss dann in der Reichweite des Access Points des Hotspots bleiben.

Und wenn die WLAN-Strecke abreißt?

Dr. Martin Junghans: Aus Sicherheitsgründen setzt sich der Roboter sofort auf den Boden und stoppt sämtliche Aufträge, bis die Verbindung wieder aufgebaut werden konnte. Es gibt auch andere Funk-Systeme, die bis zu 10 Kilometer überbrücken können. Etwa das Flymotion Persistent Systems Radio hatten wir auf dem Mobile World Congress 2022 in Barcelona im Einsatz. Dafür werden am Steuer-Panel sowie hinten am Hund zwei zusätzliche Funk-Adapter montiert. Damit könnte ich auch im Hotel sitzen und den RoboDog irgendwo draußen im Gelände steuern.

Wie kriegt er Power in die Knochen?

Dr. Martin Junghans: Man kann ihm sagen, er soll sich selbst laden. Dann läuft er zur Docking Station. Die erkennt er selbst, navigiert hin, setzt sich drauf, und lädt erst mal seinen Akku wieder nach. Das kann auch während autonomer Missionen geschehen, wenn der Akkustand zu niedrig ist. Manchmal müssen wir den Akku auch selbst händisch wechseln, etwa auf Messen. Dann legen wir den Hund auf die Seite, können den Akkustand auch direkt am Display ablesen, und bei Bedarf auch gleich komplett auswechseln. Die Motoren werden aus Sicherheitsgründen kurz ausgeschaltet, damit nicht passieren kann, solange ein Mensch daran arbeitet. Unser PLUTO ist ja mehr als nur ein Roboter, er ist ein Cobot, ein Collaborative Robot, der auch mit Menschen sicher interagieren kann.

Kann er durch schweres Gelände navigieren?

Dr. Martin Junghans: Der Roboterhund kann über große Steine, Rampen, Treppen laufen, mit Stufen bis 30cm hoch, wie man das etwa bei unebenen Geländen oder bei eingestürzten Gebäuden braucht. Hier im IBM Office haben wir nur mal einen kleinen Test-Parcours aufgebaut, weil wir halt keine großen Steine hier im Innovation Center haben. Er tariert sich an unseren Hindernissen aus, und setzt dann seine Mission fort. Der Dog geht auch eigenständig um Hindernisse herum, ohne dass man ihn lenken muss. Solange der Weg nicht komplett versperrt ist, setzt er seine Mission eben mit Umwegen fort. Sogenannte Fiducials, eine Art QR-Code, die beispielsweise in Gebäuden angebracht sind, dienen dem RoboDog als Referenz: Er weiß, wo solche Zeichen, etwa im Lagerhaus oder im Freien, angebracht sind und markiert diese Orte im Controller in Violett, nachdem er diese als Referenzpunkt erkannt hat. Auch seine Dockingstation hat so einen QR-Code. Er weiß, dass er sich dort aufladen kann. Und er weiß auf den Millimeter genau, wie er sich draufsetzen soll, damit er auf den Ladekontakten korrekt positioniert wird.

Kann man den Hund trainieren?

Dr. Martin Junghans: Ich kann dem Hund zum Beispiel einen Autowalk beibringen. Damit erstelle ich ein Programm, welches an diesem Fiducial startet und in den autonomen Missionsmodus geht. Ich gebe somit beispielsweise vor, auf welcher Route dieses Stockwerks hier im Watson Center der Roboter laufen soll. Ich kann ihm ebenfalls mitgeben: erstelle Bildaufnahmen an bestimmten Punkten, aus diesen und jenen Winkeln. Schicke die Bilder dann an die lokale GPU auf Deinem Buckel, um sie dort gleich mit Künstlicher Intelligenz lokal auszuwerten und andere Systeme über die Ergebnisse zu informieren. Wir machen also eine Zustandsüberprüfung: Läuft alles rund auf unserer 22sten Etage? Sieht alles gut aus? Hört sich alles okay an? Falls ja, kann der Dog seine Mission fortsetzen. Wenn wir so eine Strecke erst einmal aufgenommen haben, können wir sie immer wieder autonom abspielen. Das ist eine gute Ergänzung zu rein manuellen Einzelaufgaben. So kann der RoboDog die Datensammlung effektiv unterstützen.

Gibt es auch einen Sattel?

Dr. Martin Junghans: Nein, er kann nur circa 14 kg Payload aufnehmen. Er kann aber mehr ziehen, als er tragen kann. Es gibt verschiedene Aufbauten. Wir haben an unserem Hund viele Kameras mit Optik und Laser und viel Leistung für die lokale Datenverarbeitung gewählt. Es gibt aber auch andere Lidar-Scanner, die Scans bis zu 100 Metern erlauben, Gas-Sensoren, oder Geräte zur Vibrationsmessung und akustischen Bildgebung. Oder einen Greifarm. Damit kann der RoboDog Sachen greifen, oder ziehen. Er kann sogar Türen öffnen.

Was leistet der Edge-PC auf dem Hunde-Buckel?

Dr. Junghans: Das ist ein normaler, leistungsstarker Computer. Man kann da auch noch weitere IoT-Geräte anschließen. Etwa Sensoren für Strahlung, Luftqualität, Feinstaub, et cetera. Man kann den Dog mitsamt Sensoren auch in gefährliche Gebiete schicken, wo der Mensch sich fernhalten sollte.

Was bringt 5G im Einsatz?

Dr. Martin Junghans: Wenn Sie zum Beispiel hunderte von diesen Robotern haben, wie kommunizieren diese dann mit der Außenwelt? Woher bekommen sie zum Beispiel Kartendaten, Arbeitsaufträge oder wohin senden sie ihre Ergebnisse? Da geht es mobil halt idealerweise via 5G-Funk rein ins Netz und raus. Und wie verwalten Sie dann die Applikationen? Die System-Admins können ja nicht ständig mit Daten-Kabeln hinter hunderten Robotern herlaufen, nur um das System zu managen. Na klar: Mit einem zentralen System aus der Cloud! Das geht via 5G und Automation sehr elegant und effizient.

Verträgt er auch Wasser von unten und oben?

Dr. Martin Junghans: Er ist bis IP54 zertifiziert. Etwas Regen hält er aus. Hitze bis zu 45 Grad Celsius. Und Kälte bis minus 20 Grad. Durch matschige Pfützen kann er nicht wandern. Er ist auch kein Taucher, und kein Schwimmer.

Könnte ich ihn an der Leine durch Schwabing führen?

Dr. Martin Junghans: Klar: Entweder Sie steuern ihn über den Joystick am Controller. Oder sie ziehen ihn einfach kräftig an der Leine hinter sich her. Wir haben auch schon mal programmiert, dass der Roboter einem Licht folgt. Nun folgt er auch, wenn wir die Taschenlampe am Handy einschalten. Man kann auch sagen: Folge einer Gruppe von Menschen. Wir haben genug Leistung für die Bildverarbeitung in der GPU hinter den optischen Kameras und hinter den Thermalkameras. Sie können auch mit ihm tanzen, ihn loben, oder streicheln.

Steuern Sie das Tanzen des Hundes, wie im Video zu sehen, jetzt selbst?

Dr. Martin Junghans: Teils, teils. Ich gebe nur die groben Anweisungen. Den detaillierten sicheren Bewegungsablauf übernimmt die Athletische Intelligenz, und das Springen und Hüpfen macht er in diesem Modus dann automatisch. Am Ende ist das alles Sensorik: Sie hilft, mit den Menschen zusammen zu arbeiten, um uns unterstützen zu können.

Vielen Dank für die Demonstration und das Gespräch, Herr Dr. Junghans.

(ID:48262412)

:quality(80)/p7i.vogel.de/wcms/c5/45/c54568adfee2a4c6ed992a94abebdb5e/0126992413v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/13/3f/133f5ccfbd6ce74a4f52ca35ea85669f/0127552212v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/43/e4/43e42f37cc71f12e6ae46717e700644e/0126701619v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/3b/b8/3bb80b6a0c2e58c6adbe7b40df86aa12/0130692502v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/e8/38/e8387251b85fc72e0f56d2fa1915043d/0129328744v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/95/d6/95d6c599b3ff7ee542b413a6bf68af69/0129076535v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/ae/f1/aef1db70325fb40dde674f774f583eb5/0130594750v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/3b/ff/3bfffe7201cab3bb7cb2988549db0c39/0131528304v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/d2/91/d29106faa9c797de960292838ae455ee/0131601665v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/78/39/78393d4add08a8ef46e4ac1cbfddadbd/0131124773v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/31/df/31df70dc9aba2df0756027ace9211392/0131107808v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/16/f2/16f28feaa8303c945c89d00f4bb729cd/0131061532v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/db/25/db25b42919c7b89e74159db9b83009cb/0131107828v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/be/fb/befb8db9f26b45c7d428f861f1efb8c0/0131549908v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/fe/b7/feb71e254300b6fbb7068fce0a094d7d/0131548512v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/01/8f/018fbf10657dc3731cd869bc69ba5570/0130772709v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/67/d2/67d2826999d0ccbbb938fedc53387e33/0131077259v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/14/d5/14d5efd497f11f13f698542ca3719a76/0130883884v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/0e/19/0e19eb5a1ab074734c0597eacdbf030c/0131327372v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/2e/04/2e041e93b1d72f6580291bb5f234b5c5/0130963060v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/81/bf/81bf238709bbe95944c3060987a03a87/0130887672v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/b6/f7/b6f78db91e856c49b8cdb62d1ac26bdc/0130861223v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/16/c8/16c8ff5b6ee25fe71508977862c68645/0131567078v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/dc/f0/dcf076154dec7241a774d7d91c95ed93/0131054135v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/a4/96/a4960aec18b7dc7f0d33194dafdf44b8/0131065219v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/e3/7a/e37a853307b036842e48949f5a0f3826/0130736761v1.jpeg)

:quality(80)/images.vogel.de/vogelonline/bdb/1958000/1958080/original.jpg)

:quality(80)/images.vogel.de/vogelonline/bdb/1958000/1958082/original.jpg)

:quality(80)/images.vogel.de/vogelonline/bdb/1958000/1958083/original.jpg)

:quality(80)/images.vogel.de/vogelonline/bdb/1958000/1958084/original.jpg)

:quality(80)/p7i.vogel.de/wcms/80/06/8006dfab17cd0443ecd5457a264148f1/0128067470v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/91/4a/914af91e26001e29b14f4ae818b80302/0127841595v1.jpeg)